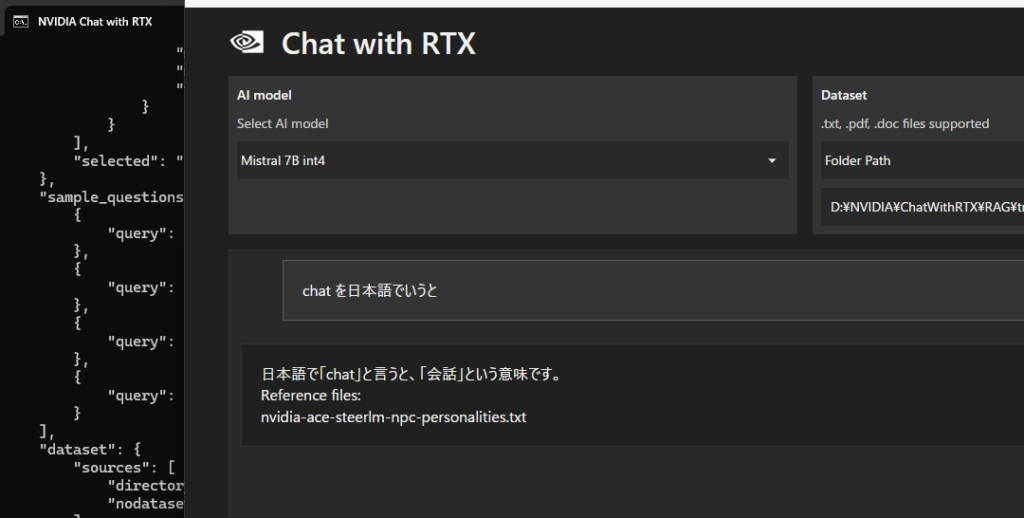

nVIDIA が提供している Chat with RTX は Windows11 で動く。

メモリは2.5GB程度消費してて、ディスクは30GBを越えた程度諸費。

試したのはRTX3060をつけた自作機だけど結構速い応答をする。

プログラミング、読書、「みのまこ軌道」のことなど

nVIDIA が提供している Chat with RTX は Windows11 で動く。

メモリは2.5GB程度消費してて、ディスクは30GBを越えた程度諸費。

試したのはRTX3060をつけた自作機だけど結構速い応答をする。

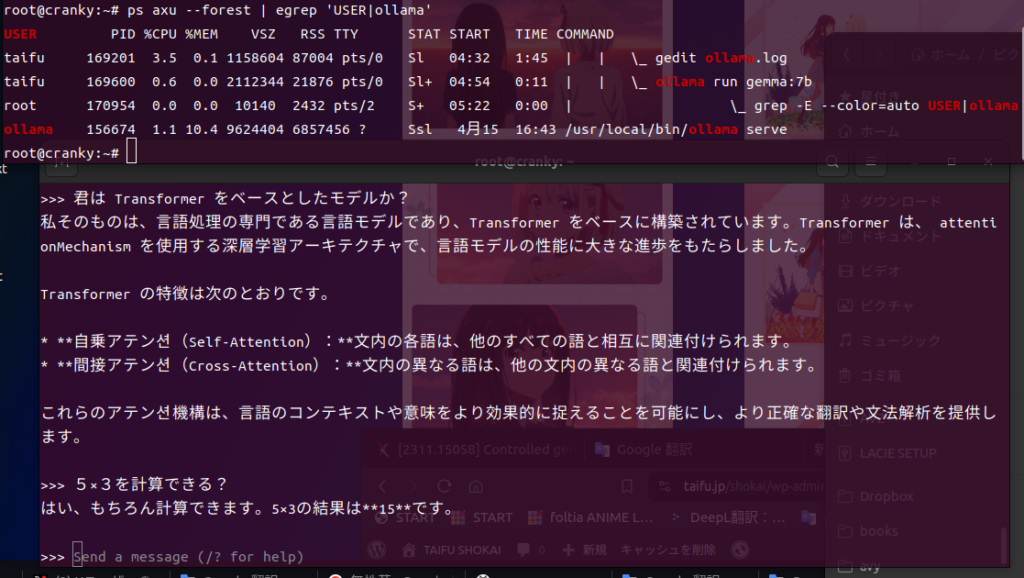

すでに日本語が使えるモデルが公開されていました。

https://ollama.com/library/gemma

LLM(大規模言語モデル)が皮肉にも量子化技術によりどんどん小型化しているようです。

とりあえず Gemma の 7b(70億パラメータ)版を動かしてみました。

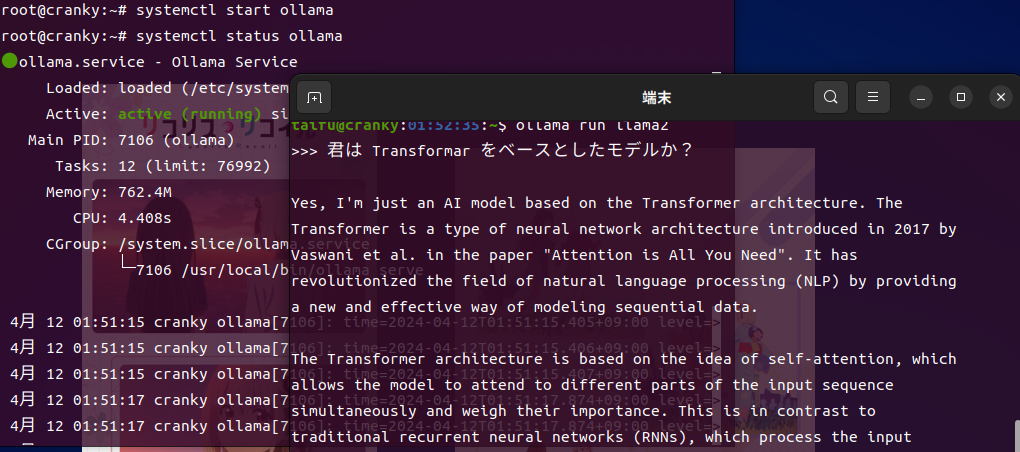

家の Ubutu 22.04 のマシンに Ollama 入れたらすんなり Llama2 が動いた。

Ollama のインストールは “curl https://ollama.ai/install.sh | sh”